Многие поначалу эксклюзивные тайтлы игровых консолей рано или поздно приходят на ПК, но порой дорога занимает не просто месяцы, а целые годы, особенно если речь идет о проектах, которыми распоряжается Sony. Что и говорить, восьмая часть серии God of War, увидевшая свет в 2018 году, когда самой мощной PlayStation была PS4 Pro, — один из рекордсменов в этом отношении. Не касаясь достоинств игрового процесса, можно задать вопрос: а чем проект четырехлетней давности в состоянии удивить геймеров, привыкших к графике персональных компьютеров в эпоху аппаратного рейтрейсинга и видеокарт с энергопотреблением выше 300 Вт? Но оказалось, что God of War на ПК выглядит более чем современно, а вот его требования к железу, кажется, недалеко ушли от списка оборудования, которое было доступно нам в том самом 2018 году. Проиллюстрируем это языком чисел и скриншотов.

⇡#Настройки качества графики

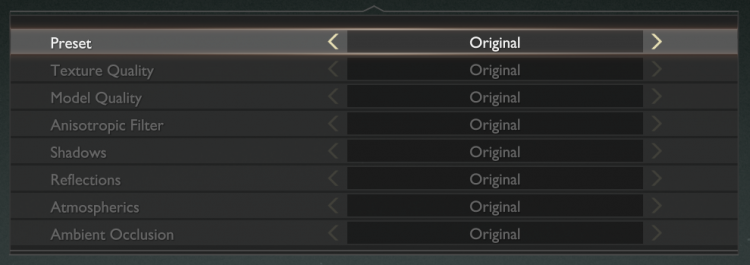

Как и многие другие тайтлы с консольным прошлым, версия God of War для Windows не балует игроков разнообразием настроек графики. Доступно лишь семь опций, и, разумеется, их все можно регулировать одновременно, установив один из четырех уровней детализации: от низкого до ультравысокого. По умолчанию игра работает в «оригинальном» режиме, который, по замыслу разработчиков, олицетворяет то, как выглядел God of War на PlayStation 4. А все более высокие настройки вплоть до Ultra представляют собой апгрейд графической оболочки, использующий возможности новых GPU и щедрый объем локальной памяти современных видеокарт. Действительно, по кадрам с максимальным качеством заметно, что God of War выглядит как минимум ничуть не хуже громких ААА-проектов, которые появились на ПК за последний год. Не хватает лишь поддержки аппаратного рейтрейсинга, но это, по всей видимости, потребовало бы слишком трудоемкой модификации всех ресурсов игры и кастомного движка студии Santa Monica.

Зато есть широкие возможности масштабирования изображения: пользователям ускорителей GeForce RTX доступна опция DLSS, а всем остальным — FidelityFX Super Resolution. Мы уже не раз видели в действии и тот и другой метод апскейлинга, так что сейчас не будем заострять внимание на качестве их реализации. DLSS со времен перехода на версию 2.0 еще ни разу не дал повода для разочарования, а FSR — в силу того, что это более простой, исключительно пространственный алгоритм, лишенный временной компоненты — обеспечивает заведомо не столь качественный результат, как нейросеть NVIDIA. Кроме того, тесты видеокарт покажут, что все более-менее мощные устройства последнего и предпоследнего поколения легко справляются с God of War по меньшей мере в народном режиме 1080p. Как следствие, апскейлинг понадобится только самым маломощным игровым машинам.

Что касается качества графики в «оригинальном» режиме, то, если честно, владельцы компьютеров, которым не по зубам максимальные параметры, теряют не так уж много. Вот низкие настройки уже заметно портят картинку, хотя, заметим, дают лишь небольшой выигрыш по частоте смены кадров.

|

Low |

Original |

Ultra |

||

|

Low |

Original |

Ultra |

||

|

Low |

Original |

Ultra |

||

|

Low |

Original |

Ultra |

||

|

Low |

Original |

Ultra |

||

|

Low |

Original |

Ultra |

||

|

Low |

Original |

Ultra |

⇡#Тестовый стенд, методика тестирования

| Тестовый стенд | |

|---|---|

| CPU | AMD Ryzen 9 5950X (4,4 ГГц, фиксированная тактовая частота всех ядер) |

| Материнская плата | ASUS ROG Strix X570-E Gaming (Resizable BAR вкл.) |

| Оперативная память | G.Skill Trident Z RGB F4-3200C14D-16GTZR, 4 × 8 Гбайт (3600 МТ/с, CL17) |

| ПЗУ | Intel SSD 760p, 2048 Гбайт |

| Блок питания | Corsair AX1200i, 1200 Вт |

| Система охлаждения CPU | Corsair iCUE H115i RGB PRO XT |

| Корпус | Открытый стенд |

| Операционная система | Windows 10 Pro x64 |

| ПО для GPU AMD | |

| Все видеокарты | AMD Radeon Software Adrenalin 2020 Edition 22.1.1 |

| ПО для GPU NVIDIA | |

| Все видеокарты | NVIDIA GeForce Game Ready Driver 411.23 |

Тестирование производительности выполнено с помощью утилиты OCAT в одной из открытых начальных локаций игры. Показатели средней и минимальной кадровых частот выводятся из массива времени рендеринга индивидуальных кадров, который OCAT записывает в файл результатов.

Средняя частота смены кадров на диаграммах является величиной, обратной среднему времени рендеринга кадра. Для оценки минимальной кадровой частоты вычисляется количество кадров, сформированных в каждую секунду теста. Из этого массива чисел берется значение, соответствующее 1-му процентилю распределения.

⇡#Участники тестирования

- AMD Radeon RX 6900 XT (1825/2250 МГц, 16 Гбит/с, 16 Гбайт);

- AMD Radeon RX 6800 XT (1825/2250 МГц, 16 Гбит/с, 16 Гбайт);

- AMD Radeon RX 6800 (1700/2105 МГц, 16 Гбит/с, 16 Гбайт);

- AMD Radeon RX 6700 XT (2321/2581 МГц, 16 Гбит/с, 12 Гбайт);

- AMD Radeon RX 6600 XT (2064/2607 МГц, 16 Гбит/с, 8 Гбайт);

- AMD Radeon RX 6600 (1626/2491 МГц, 14 Гбит/с, 8 Гбайт);

- AMD Radeon RX 6500 XT (2420/2825 МГц, 18 Гбит/с, 4 Гбайт);

- AMD Radeon RX 5700 XT (1605/1905 МГц, 14 Гбит/с, 8 Гбайт);

- AMD Radeon RX 5700 (1465/1725 МГц, 14 Гбит/с, 8 Гбайт);

- AMD Radeon RX 5600 XT OC (1420/1750 МГц, 14 Гбит/с, 6 Гбайт);

- AMD Radeon RX 5600 XT (1235/1620 МГц, 12 Гбит/с, 6 Гбайт);

- AMD Radeon RX 5500 XT (1607/1845 МГц, 14 Гбит/с, 8 Гбайт);

- AMD Radeon RX 5500 XT (1607/1845 МГц, 14 Гбит/с, 4 Гбайт);

- AMD Radeon VII (1400/1750 МГц, 2 Гбит/с, 16 Гбайт);

- AMD Radeon RX Vega 64 LC (1406/1677 МГц, 1,89 Гбит/с, 8 Гбайт);

- AMD Radeon RX Vega 64 (1247/1546 МГц, 1,89 Гбит/с, 8 Гбайт);

- AMD Radeon RX Vega 56 (1156/1471 МГц, 16 Гбит/с, 8 Гбайт);

- AMD Radeon RX 590 (1469/1545 МГц, 8 Гбит/с, 8 Гбайт);

- AMD Radeon RX 580 (1257/1340 МГц, 8 Гбит/с, 8 Гбайт);

- AMD Radeon RX 570 (1168/1244 МГц, 7 Гбит/с, 4 Гбайт);

- AMD Radeon RX 560 16 CU (1175/1275 МГц, 7 Гбит/с, 4 Гбайт);

- AMD Radeon RX 560 14 CU (1090/1175 МГц, 7 Гбит/с, 4 Гбайт);

- NVIDIA GeForce RTX 3090 (1395/1695 МГц, 19,5 Гбит/с, 24 Гбайт);

- NVIDIA GeForce RTX 3080 Ti (1365/1665 МГц, 19 Гбит/с, 12 Гбайт);

- NVIDIA GeForce RTX 3080 (1440/1710 МГц, 19 Гбит/с, 10 Гбайт);

- NVIDIA GeForce RTX 3070 Ti (1575/1770 МГц, 19 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 3070 (1500/1730 МГц, 14 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 3060 Ti (1410/1665 МГц, 14 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 3060 (1320/1837 МГц, 15 Гбит/с, 12 Гбайт);

- NVIDIA GeForce RTX 2080 Ti Founders Edition (1350/1635 МГц, 14 Гбит/с, 11 Гбайт);

- NVIDIA GeForce RTX 2080 SUPER (1650/1815 МГц, 15,5 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 2080 Founders Edition (1515/1800 МГц, 14 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 2070 SUPER (1605/1770 МГц, 14 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 2070 Founders Edition (1410/1710 МГц, 14 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 2060 SUPER (1470/1650 МГц, 14 Гбит/с, 8 Гбайт);

- NVIDIA GeForce RTX 2060 (1365/1680 МГц, 14 Гбит/с, 6 Гбайт);

- NVIDIA GeForce GTX 1660 Ti (1500/1800 МГц, 12 Гбит/с, 6 Гбайт);

- NVIDIA GeForce GTX 1660 SUPER (1530/1830 МГц, 14 Гбит/с, 6 Гбайт);

- NVIDIA GeForce GTX 1660 (1530/1785 МГц, 8 Гбит/с, 6 Гбайт);

- NVIDIA GeForce GTX 1650 SUPER (1530/1770 МГц, 8 Гбит/с, 4 Гбайт);

- NVIDIA GeForce GTX 1650 (1485/1725 МГц, 8 Гбит/с, 4 Гбайт);

- NVIDIA GeForce GTX 1080 Ti (1480/1582 МГц, 11 Гбит/с, 11 Гбайт);

- NVIDIA GeForce GTX 1080 (1607/1733 МГц, 10 Гбит/с, 8 Гбайт);

- NVIDIA GeForce GTX 1070 Ti (1607/1683 МГц, 8 Гбит/с, 8 Гбайт);

- NVIDIA GeForce GTX 1060 (1506/1708 МГц, 9 Гбит/с, 6 Гбайт);

- NVIDIA GeForce GTX 1060 (1506/1708 МГц, 8 Гбит/с, 3 Гбайт);

- NVIDIA GeForce GTX 1050 Ti (1290/1392 МГц, 7 Гбит/с, 4 Гбайт).

Прим. В скобках после названий видеокарт указаны базовая и boost-частота согласно спецификациям каждого устройства. Видеокарты с заводским разгоном приведены в соответствие с референсными параметрами (или приближены к последним) при условии, что это можно сделать без ручной правки кривой тактовых частот. В противном случае используются настройки производителя.